盲目行动的问题

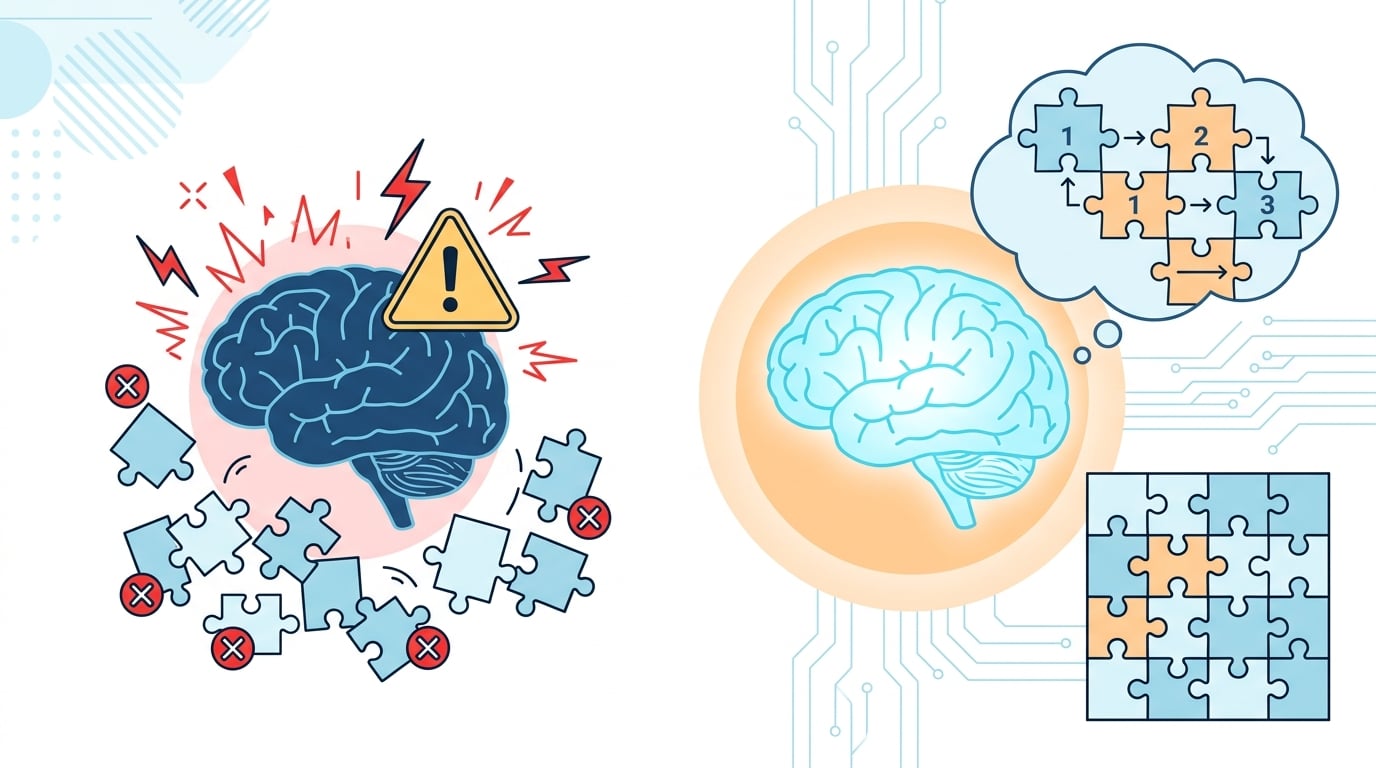

在解决复杂的逻辑问题或获取多条信息时,强迫AI立即决定采取某个操作,可能会导致灾难性的错误。

想想人类是如何拼装拼图的:

- 他们不会随意抓起一块拼图就强行塞进板中。

- 他们会通过心理或口头方式规划策略: “首先,我需要找到用于边框的平边拼图块,然后再看看这块蓝色拼图是否合适。”

同样地,如果我们要求AI 仅 只输出一个操作——跳过推理阶段——它就是在“盲目行动”。由于没有理清回答问题的前提条件,它往往会猜测、幻觉化,或完全选择错误的工具。

大声思考

语言模型是逐个标记构建逻辑的。通过强制AI“大声思考”(生成分析问题的文本) 在 它选择操作之前,我们为它提供了必要的思维空间,使其能够得出正确的逻辑结论。